Dans une vidéo 360°, le son est aussi important que l'image pour immerger le spectateur. Euronews vous explique comment produire la bande-son d'une vidéo 360°, du tournage à la post-production.

Thomas Besson, mixeur et ingénieur du son, a réalisé pour Euronews le mixage d'un documentaire 360° immersif sur les feux de forêt au Portugal.

Thomas a collaboré sur la post-production de productions audiovisuelles françaises et internationales, pour la télévision et le cinéma. Il nous explique comment produire la bande-son d'une vidéo 360°, du tournage à la post-production.

Les contenus immersifs comme la VR et la vidéo 360° se développent depuis quelques années dans les jeux vidéo et sur Internet.

Aujourd’hui, de nombreux médias utilisent ce format pour du divertissement ou couvrir l’actualité - comme Euronews.

Les tournages se font donc en 360 degrés grâce à l'utilisation de caméras spécifiques. Ces vidéos peuvent être visualisées sur ordinateur, tablette, smartphone ou Cardboard.

Mais alors quid du « son 360 », qui joue lui aussi un grand rôle dans l’immersion, et l’effet de présence, de l’audience ?

En tant qu’ingénieur du son pour la télévision et le cinéma, je me suis naturellement intéressé aux productions en 'VR 360'.

Jusqu’à très récemment, la plupart des contenus en réalité virtuelle ne comprenaient pas un son immersif. Lors du visionnage, la bande son ne suivait pas la gyroscopie de l’image et le point de vue sonore du spectateur n’était donc pas lié à ce qu’il voyait.

Résultat, le spectateur avait tendance à se tourner dans tous les sens pour chercher l’action dans l’espace 360°, quitte à rater l’essentiel de la vidéo.

Depuis peu, des outils se développent pour pouvoir associer un son immersif à la vidéo à 360°.

Le but est simple : donner au spectateur les clés pour pouvoir regarder l’action dans la vidéo au bon endroit, au bon moment.

Un véritable storytelling sonore devient alors possible, donnant aux images tout leur sens.

Le spectateur peut alors se faire happer par l’action ou la narration et concentrer ses sens visuels et auditifs - désormais liés - dans la même direction.

Par exemple, si dans une vidéo un spectateur entend des enfants derrière son épaule gauche, il se retournera et verra deux frères qui jouent dans un salon. Le son des enfants qui jouent lui parviendra alors comme s’ils étaient réellement face à lui. Un autre son, ailleurs, pourra ensuite attirer et guider son attention, pour qu’il concentre son attention sur l’action de la prochaine scène de l’histoire.

Dans le cadre du développement de contenus immersifs à Euronews, nous avons donc étudié avec Laurence Jalinaud, responsable du service mixage magazine, un processus, du tournage à la post-production, pour produire une bande-son 360° pour leurs vidéos immersives.

1. Le Tournage

Lors du tournage du reportage, le format utilisé pour capturer une scène sonore à 360° est l’ambisonique.

Qu'est ce que l’ambisonique?

« La technologie ambisonique, basée sur une théorie de la localisation des sons, est apte à reproduire le champ sonore complet en décomposant les caractéristiques d’un champ sonore en composantes harmoniques d’une sphère, appelées W, X, Y et Z, utilisant les sources ponctuelles distribuées dans l’auditorium (HP) de façon complémentaire pour recréer ces composantes directionnelles. »

Dans cette localisation :

X désigne l’axe Avant/Arrière,

Y l’axe Gauche/Droite,

Z l’axe Haut/Bas,

W la profondeur ou la distance;

L'ambisonique est un format de description de la scène en trois dimensions. que l’on peut décoder ensuite dans n’importe quelle format de restitution . ( en Multicanal 5.1, ou en stéréo Binaural). L’ambisonique d’ordre 1 (Ou format B) se compose de 4 canaux, et l’on peut avoir des modes plus élevés avec plus de canaux. ( Ordre 2: 9 canaux, Ordre 3: 16 canaux)

Plusieurs caméras permettent de réaliser une captation du son ambisonique, notamment l’Insta 360 Pro qui est équipée de quatre micros qui permettent un enregistrement ambisonique “ordre 1er” (quatre canaux).

Si la caméra ne le permet pas, un système portatif de captation sonore ambisonique doit être utilisé en parallèle et synchronisé à la prise de vue.

Par exemple, on peut utiliser un micro ambisonique relié à un enregistreur quatre pistes minimum. (Exemple : Micro Sennheiser Ambéo VR mic + Enregistreur Zoom H6) Ou bien utiliser un enregistreur avec système ambisonique intégré. (Ex : Enregistreur Zoom H2N en mode “Spatial Sound”)

Attention : Lors du tournage, il faut s’attacher à respecter l’axe du dispositif de captation ambisonique par rapport à celui de la vidéo, pour respecter la localisation respective du son et de l’image 360. Si ce n’est pas le cas, le risque principal en mixage est que la spatialisation sonore ne concorde pas avec la localisation visuelle de la scène.

On peut par la suite corriger l’axe (“l'azimut”) de la scène avec différents plug-ins en post production.

2. La post-production

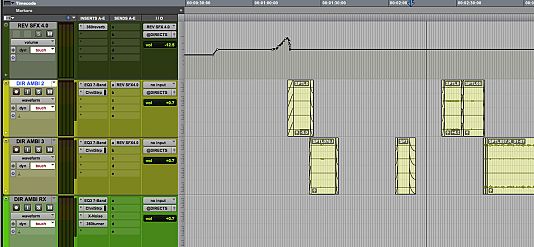

Lorsque le montage vidéo est terminé vient l’étape du mixage sur un DAW (Digital Audio Workstation) comme Pro Tools ou Reaper par exemple.

La particularité d’un mixage 360° est que contrairement au multicanal, il n’y a pas un positionnement fixe avec un plan sonore “Frontal” ( dans l’image) et des “surrounds” (en hors-champ).

En effet, de la même manière qu’il n’y a plus de hors-champ au niveau visuel avec une prise de vue à 360°, tous les sons entendus dans la scène à 360° doivent pouvoir passer devant le spectateur si son point de vue l’exige. Et il nous faudra une précision des sources localisées qui soit la même dans toute la sphère.

Les prises de son ambisoniques nous donnent déjà une belle réalité pour la restitution sonore de la scène, mais on va devoir s’appuyer sur un sound design complémentaire pour donner du relief à notre champ sonore 360.

A l’aide d’ambiances stéréos, d’effets ponctuels ou de bruitages, on va renforcer des événements sonores déjà captés en ambisonie, ou qui n’existaient pas.

On aura donc des pistes mono, stéréo ou même multicanales qu’il va falloir associer aux sources ambisoniques du tournage.

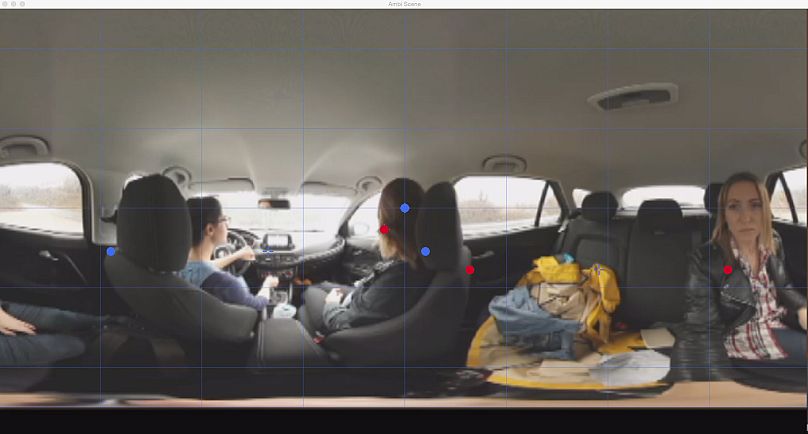

En utilisant l’image 360 déroulée en sa totalité en 2D (Représentation équirectangulaire), on va construire une spatialisation 360 de la scène.

L’objectif est de déterminer à chaque position dans l’image la spatialisation d’une piste à un instant T.

Pour que le spectateur soit en totale immersion, il va falloir que les ambiances soient fournies devant comme derrière lui, et ce à tout moment. De plus, pour chaque événement sonore en déplacement, il est nécessaire que la source soit très précise, pour pouvoir mieux la localiser.

Le format ambisonique sera donc aussi utilisé en mixage, jusqu’à la livraison du master.

Mixer en ambisonique permet de localiser toutes les sources de l’image 360, et de s’adapter ensuite au point de vue du spectateur en suivant la gyroscopie de l’image.

On va donc positionner chaque source sonore dans l’espace selon les quatre paramètres W,Y,Z,X.

Pour cela, on utilisera un plug-in à intégrer au DAW qui permet de spatialiser chaque source sur le positionnement 360 de l’image.

Chaque piste Mono, Stéréo ou Multicanal ( Quadri, 5.1,7.1,…) va pouvoir être automatisée à un instant T, à un endroit précis dans la sphère 3D de la scène.

On pourra mélanger aussi les prises de son ambisoniques dans le mixage avec la possibilité de les corriger en azimut ou en largeur.

Pour pouvoir mener à bien toutes ces opérations il faut un logiciel qui permette de travailler en multicanal, en 4.0, en ordre 1 et en 9.0 voire 16.0 pour les ambisoniques d’ordres plus élevés.

On a maintenant la possibilité de travailler dans les DAW en 1er, 2ème et 3 ème ordre (ex: Protools 12.8.3), ce qui améliore considérablement la précision et la localisation des sources.

Il existe toutefois deux formats distincts de mixage ambisonique: l’AmbiX et le Fuma. Entre ces deux formats, la différence résulte surtout dans l’ordre des canaux.

Le Format Fuma utilise un ordre des canaux et une pondération qui ont été inventés par les deux chercheurs Furse et Malham. Il répertorie les canaux d’un format B (1er ordre) dans l’ordre suivant: W, X, Y, Z. Le canal W étant atténué de 3dbs.

Le Format AmbiX utilise, quant à lui, un ordre et une pondération différente du Fuma. Il répertorie les canaux en utilisant la numérotation des canaux ambisoniques ( ACN): W,Y,Z,X. Ils ont tous un gain uniforme.

L’AmbiX est le plus utilisé par la plupart des plateformes. YouTube n’utilise actuellement que celui-ci, et Facebook accepte le format Fuma et AmbiX.

Ensuite, chaque plateforme convertit le mixage ambisonique en stéréo binaural pour pouvoir être écouté au casque par le spectateur.

Rappelons que le son sera traité en binaural s’il doit être placé derrière l’auditeur, donc il sera « teinté » pour sembler venir de derrière le spectateur. (comme avec les fonctions de transfert de l’oreille). Il faut donc que les sources soient claires et bien spatialisées au départ.

Ainsi, on convertira avant la mise en ligne le master ambisonique en master binaural lors du mixage.

Le but étant de simuler le décodage binaural qui sera réalisé par YouTube ou Facebook lors de la diffusion.

Pour cela, un plug-in spécifique sera utilisé en monitoring dans la station de mix.

Qu'est-ce que le Stéréo Binaural?

Il s'agit d' un format permettant de reproduire la perception sonore naturelle humaine, et-ce par restitution au casque.

Il retranscrit en fait les fonctions de transfert relative à l’oreille ( HRTF: Head Relative Transfert fonction), et donne la sensation à l’auditeur qu’un son est spatialisé dans un espace 3D. On peut donc entendre un son derrière nous alors que l’on écoute au casque avec 2 canaux.

Pour mieux comprendre, vous pouvez écouter ces démos rassemblées par Radiofrance.

La particularité de l'ambisonique étant que les sources spatialisées dans l'image 360 tournent avec le point de vue de l'image, on ne peut donc pas fixer une source qui restera immobile lors de la diffusion.

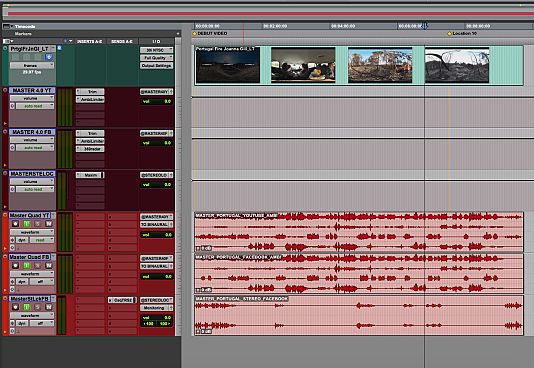

Pour remplir cette mission, on va donc utiliser une piste stéréo additionnelle, appelée « Stereo Locked » qui nous permettra d’isoler des sources du mixage qui ne doivent pas intégrer le flux ambisonique.

On pourra ainsi envoyer la voix off ou les musiques stéréos qui ne doivent pas être spatialisées dans le mix.

Une fois le mixage terminé, on aura alors une piste multicanale pour le mixage ambisonique et une piste stéréo fixe.

Pour ma part, j’utilise Pro Tools HD12 et j’ai testé deux suites de plug-ins de mixage VR360: la suite Ambi Bundle de Noisemakers et 360 Pan Suite 3 de AudioEase.

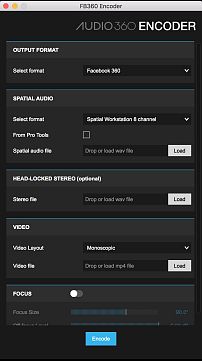

Vient alors le temps de l’encodage du Master IMAGE+SON en vue du chargement sur une plate-forme vidéo compatible avec le visionnage à 360°.

On utilisera le plug in gratuit de Facebook, FB 360 Encoder.

3. La diffusion

Actuellement, si YouTube et Facebook sont compatibles avec les vidéos 360°, ces plateformes n’acceptent pas tous les formats audio 360° :

Facebook accepte l’Ambix 1er et 2ème ordre et a prévu une piste additionnelle stéréo lockée qui permet d’isoler les sons qui ne doivent pas tourner avec la gyroscopie.

Cela permet par exemple d’injecter dans cette piste a voix off ou la musique qui ne doivent pas varier en fonction des déplacement dans l’espace de l’auditeur.

Le réseau social accepte aussi le Fuma 1er et 2ème ordre.

YouTube utilise encore l’ambisonique Format B ( Ordre 1) en 4.0

L’inconvénient principal est qu’il ne prévoit pas encore de piste Stereo Locked pour isoler la voix off ou la musique.

Vous pouvez écouter la différence entre les formats audio 360° de YouTube et Facebook grâce aux vidéos suivantes :

Sur YouTube :

Sur Facebook :