Près de 200 clips concernant l'ICE générés par l'IA ont été visionnés des millions de fois sur les réseaux sociaux, selon des données communiquées au Cube.

La chaîne publique allemande ZDF a rappelé un correspondant américain à la fin du mois de février après l'apparition d'un clip généré par l'intelligence artificielle dans un reportage sur les agents de l'immigration et des douanes américaines (ICE).

PUBLICITÉ

PUBLICITÉ

PUBLICITÉ

PUBLICITÉ

La chaîne s'est excusée d'avoir utilisé ce clip, qui montrait des enfants s'accrochant à leur mère lors de son arrestation par des agents de l'ICE. La vidéo comportait un filigrane Sora, indiquant clairement qu'elle avait été créée par l'outil vidéo d'OpenAI.

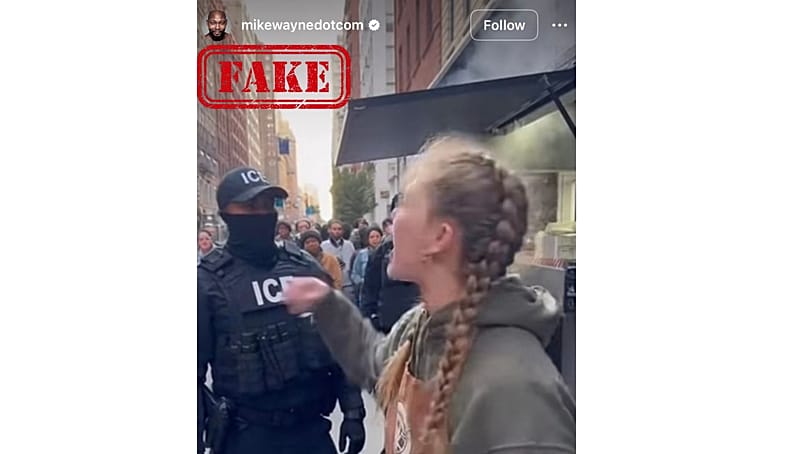

Le Cube, l'équipe de vérification des faits d'Euronews, a constaté que cette vidéo faisait partie des milliers de clips d'agents de l'ICE générés par l'IA qui inondent les médias sociaux, dont beaucoup ne sont pas clairement identifiés et qui accumulent collectivement des millions de vues.

Un modèle cohérent

Les données communiquées au Cube par l'entreprise de détection d'IA TruthScan montrent plus de 200 clips courts montrant des agents de l'ICE poursuivis par des enseignants, se battant dans des bars et se faisant arrêter par le NYPD (New York City Police Department) dans le métro.

TruthScan a déclaré avoir récupéré plus de 200 vidéos sur un seul compte Instagram. Les vidéos sont courtes, dramatiques et chargées d'émotion.

Le Cube a constaté que le compte continue de poster en masse des clips de l'ICE générés par l'IA, certains obtenant des milliers, et d'autres des millions, de vues.

Plusieurs indices montrent que ces vidéos ne sont pas réelles : dans un exemple, de la vapeur semble s'élever à travers une surface solide lors d'une confrontation entre un agent de l'ICE et l'employé d'un café, un signe subtil que le clip est synthétique.

Selon TruthScan, chaque vidéo durait exactement 10 ou 15 secondes, ce qui suggère fortement qu'elles ont été générées à l'aide du modèle vidéo Sora 2 d'OpenAI, qui offre aux utilisateurs des options de vidéo de 10 ou 15 secondes.

Contrairement à de nombreuses vidéos générées par l'IA qui contiennent un filigrane, la majorité de ces clips ICE n'en contiennent pas.

De même, en novembre dernier, 404 Media a rapporté que des vidéos d'agents de l'ICE générées par l'IA et provenant d'un compte Facebook étaient devenues virales (source en anglais), l'une d'entre elles ayant généré 4 millions de vues à elle seule. Les vidéos ont depuis été retirées.

Un risque plus large pour la confiance du public

Selon les experts, le risque ne se limite pas à des clips individuels étiquetés de manière incorrecte, mais s'étend à la prolifération plus large de faux contenus sur des questions politiques sensibles, ce qui peut ébranler la confiance du public.

"Il existe un risque important pour les réactions collectives aux actions des forces de l'ordre, qu'elles soient négatives ou positives", explique Ari Abelson, cofondateur d'OpenOrigins, une société spécialisée dans l'authenticité des médias qui détecte les "deepfakes".

"C'est une préoccupation pour les forces de l'ordre qui veulent conserver leur confiance, mais c'est également important pour les institutions qui les tiennent pour responsables lorsqu'elles dépassent les bornes", a déclaré Ari Abelson au Cube.

Comme dans le cas de l'émission de la ZDF, le contenu de l'ICE généré par l'IA ne se limite pas à des comptes anonymes. Il arrive même qu'il atteigne les plus hautes sphères de la fonction publique.

En janvier, la Maison Blanche a publié une image numériquement modifiée de l'activiste et avocate Nekima Levy Armstrong après son arrestation lors d'une manifestation liée à l'ICE dans le Minnesota.

Une analyse montre que l'image modifiée représente Armstrong avec une peau plus foncée et visiblement en train de sangloter par rapport à l'image originale.

La Maison Blanche a répondu aux questions concernant la manipulation de l'image par un message du directeur adjoint de la communication, Kaelan Dorr, qui dit : "Encore une fois, aux personnes qui ressentent le besoin de défendre par réflexe les auteurs de crimes odieux dans notre pays, je partage avec vous ce message : L'application de la loi se poursuivra. Les mèmes continueront".

Mme Armston s'est déclarée "dégoûtée" par la publication de cette image par la Maison Blanche.

Selon Ari Abelson, le problème se pose lorsqu'il n'y a pas de garde-fous - ou de garanties - pour indiquer clairement que le contenu est faux.

"Les caricatures politiques ont toujours été utilisées en politique, et celles-ci sont utilisées de manière très similaire", a-t-il déclaré. "La différence essentielle réside dans l'hyperréalisme des vidéos."

"Les espaces sociaux et d'information ont besoin d'une chose : la capacité de prouver qu'une photo ou une vidéo est réelle, afin que nous puissions apprécier les fausses comme des fictions et ressentir la gravité des événements de la vie réelle", a-t-il ajouté.