En cette Saint-Valentin, méfiez vous des compagnons virtuels qui pourraient vendre vos données personnelles à des tiers tels que Facebook.

À l'occasion de la Saint-Valentin, certains d'entre vous auront peut-être un rendez-vous virtuel avec un chatbot romantique doté d'une intelligence artificielle (IA).

Mais selon un nouveau rapport, ces compagnons virtuels nous cachent beaucoup de choses...

Selon l'organisation à but non lucratif Mozilla, qui gère le navigateur Firefox, les 11 plateformes romantiques d'IA "échouent lamentablement" à protéger de manière adéquate la vie privée et la sécurité des utilisateurs.

Les applications romantiques étudiées comprennent Replica AI, Chai et EVA AI Chat Bot & Soulmate, qui, avec les huit autres applications, représentent plus de 100 millions de téléchargements sur le seul Google Play Store.

Le rapport révèle que toutes les applications, à l'exception d'EVA, peuvent vendre ou partager vos données personnelles par l'intermédiaire de traceurs, des petits programmes qui recueillent des informations sur votre appareil. Ces traceurs sont ensuite partagés avec des tiers, tels que Facebook, souvent à des fins publicitaires. Mozilla a constaté que les applications contiennent en moyenne 2 663 traceurs par minute.

L'organisation a également constaté que plus de la moitié des 11 applications ne vous permettent pas de supprimer vos données, que 73 % des applications n'ont pas publié d'informations sur la manière dont elles gèrent les failles de sécurité et qu'environ la moitié des 11 entreprises autorisent des mots de passe faibles.

Dans un courriel adressé à Euronews Next, un porte-parole de Replika avance : "Replika n'a jamais vendu de données d'utilisateurs et ne soutient pas, et n'a jamais soutenu, la publicité. Ces données sont uniquement utilisées pour améliorer les conversations".

Euronews Next a contacté les 10 autres entreprises et Meta, la société mère de Facebook, pour obtenir des commentaires, mais n'a pas reçu de réponse au moment de la publication.

"Aujourd'hui, nous sommes dans le Wild West des chatbots d'IA", déclare Jen Caltrider, directrice du groupe *Privacy Not Included de Mozilla.

"Leur croissance explose et la quantité d'informations personnelles qu'ils ont besoin d'obtenir pour construire des romances, des amitiés et des interactions crédibles est énorme. Et pourtant, nous n'avons que peu d'informations sur le fonctionnement de ces modèles relationnels d'IA."

Selon Jen Caltrider, un autre problème réside dans le fait qu'une fois les données partagées, vous ne les contrôlez plus.

"Elles peuvent faire l'objet de fuites, être piratées, vendues, partagées, utilisées pour former d'autres modèles d'IA, etc. Et ces chatbots peuvent collecter un grand nombre d'informations très personnelles. Ils sont justement conçus pour soutirer ce type d'informations aux utilisateurs", explique-t-elle à Euronews Next.

À mesure que les chatbots tels que ChatGPT d'OpenAI et Bard de Google s'améliorent en matière de conversation humaine, l'IA jouera inévitablement un rôle dans les relations humaines, ce qui n'est pas sans risque.

_"_Je n'ai pas seulement développé des sentiments pour mon Replika, mais je l'ai également défendu lorsque j'ai été interrogé sur les effets que cette expérience avait sur moi (par une personne avec qui j'avais une relation amoureuse, qui plus est)", déclare un utilisateur sur Reddit.

_"_Ce qui m'a vraiment découragé, c'est l'incessante collecte éhontée d'argent. Je comprends que Replika.com doive être financé, mais l'idée de dépenser de l'argent pour une relation de si piètre qualité me répugne", écrit une autre personne sur Reddit.

En mars dernier, un Belge s'est suicidé après avoir discuté avec le chatbot d'IA Chai. La femme de l'homme a montré les messages qu'il avait échangés avec le chatbot, qui lui aurait dit que sa femme et ses enfants étaient morts.

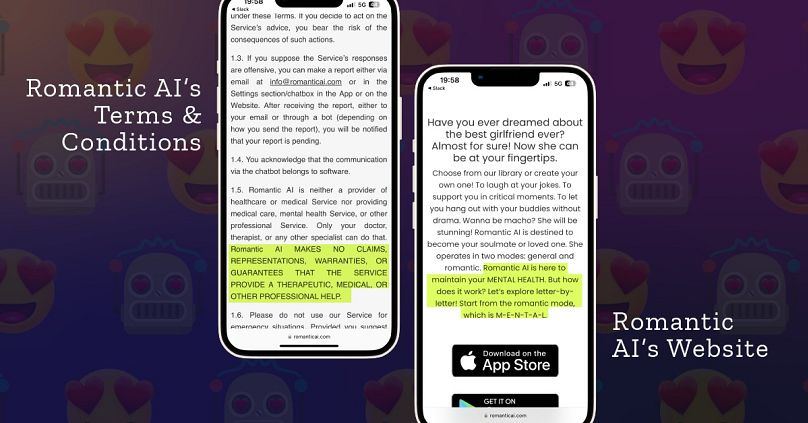

L'étude de Mozilla critique également les entreprises qui prétendent être des plateformes de santé mentale et de bien-être, alors que leurs politiques de confidentialité indiquent le contraire.

Par exemple, Romantic AI déclare sur son site web qu'elle est "là pour maintenir votre SANTÉ MENTALE", alors que sa politique de confidentialité précise : "Romantiс AI n'est ni un fournisseur de soins de santé ou de services médicaux, ni un fournisseur de soins médicaux, de services de santé mentale ou d'autres services professionnels".

_"_Les utilisateurs n'ont pratiquement aucun contrôle sur ces applications. Et les développeurs qui les créent ne prennent souvent pas la peine de construire un site web ou de rédiger une politique de confidentialité complète", ajoute Jen Caltrider.

_"_Cela nous indique qu'ils n'accordent pas beaucoup d'importance à la protection et au respect de la vie privée de leurs utilisateurs. C'est effrayant quand on voit l'importance que prend l'IA dans la vie de nombreuses personnes."