L'escalade des tensions entre l'Iran, Israël et les États-Unis a suscité une vague de vidéos en ligne. Nombre de ces contenus, vus pour certains des millions de fois, sont toutefois trompeurs.

Alors que la crise au Moyen-Orient s'intensifie, les réseaux sociaux ont été inondés d'un nombre sans précédent de vidéos et d'images trompeuses prétendant montrer des frappes et des actions militaires en Israël et en Iran.

PUBLICITÉ

PUBLICITÉ

PUBLICITÉ

PUBLICITÉ

Or, nombre de ces contenus ne relèvent absolument pas du conflit. Certains d'entre eux, visionnées par des millions de personnes, proviennent de jeux vidéo ou sont entièrement générées par intelligence artificielle.

Voici trois de ces vidéos devenues virales, avec des millions de vues, mais qui ne montrent pas ce qu’elles prétendent.

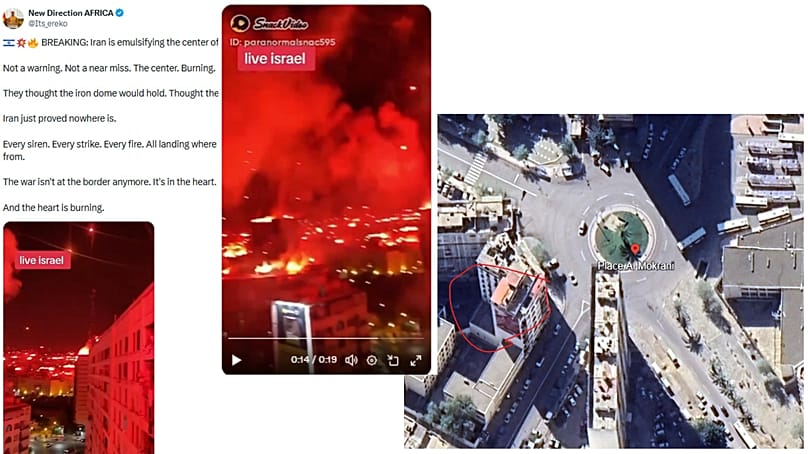

Frappe sur Tel-Aviv" ou célébrations du football algérien ?

Une vidéo largement partagée sur X prétend montrer des missiles iraniens frappant le centre de Tel-Aviv.

Elle a été visionnée par plus de 4 millions de personnes, mais elle ne représente pas Tel-Aviv.

La vidéo montre en fait des supporters de football célébrant la victoire d'un club algérien appelé CR Belouizdad, et non des missiles frappant Israël.

Nous avons géolocalisé cette séquence sur la place Al Mokrani à Alger. Le club a célébré ses victoires par le passé avec des feux d'artifice similaires, comme vous pouvez le voir ici (source en anglais)

Le Cube, l'équipe de vérification des faits d'Euronews, a démenti la même vidéo en 2023, lorsqu'elle prétendait montrer une attaque israélienne sur Gaza.

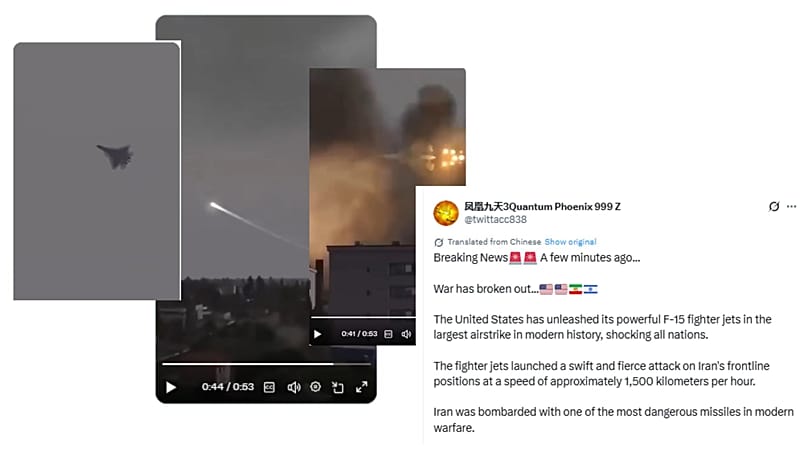

Une attaque américaine contre l'Iran ? Non, une séquence de jeu vidéo

Une autre vidéo prétend montrer une attaque militaire américaine contre l'Iran.

L'une des versions originales de ce clip a été visionnée plus de 5 millions de fois, avec une légende chinoise indiquant que "les États-Unis ont déclenché leurs puissants avions de chasse F-15 dans la plus grande frappe aérienne de l'histoire moderne".

Il s'agit en fait de simulations d'un SU-57 de l'armée de l'air russe dans Arma 3, un jeu vidéo de simulation militaire qui utilise un style photoréaliste.

Néanmoins, des millions de personnes ont vu cette vidéo en même temps que d'autres séquences de jeux vidéo se faisant passer pour des vidéos légitimes de la guerre.

Une autre vidéo qui a accumulé plus de 7 millions de vues, prétend montrer "un avion iranien VS un navire américain".

Elle a été partagée puis supprimé par le gouverneur du Texas, Greg Abbott. Il s'est finalement avéré qu'il s'agissait d'un extrait du jeu vidéo de simulation War Thunder.

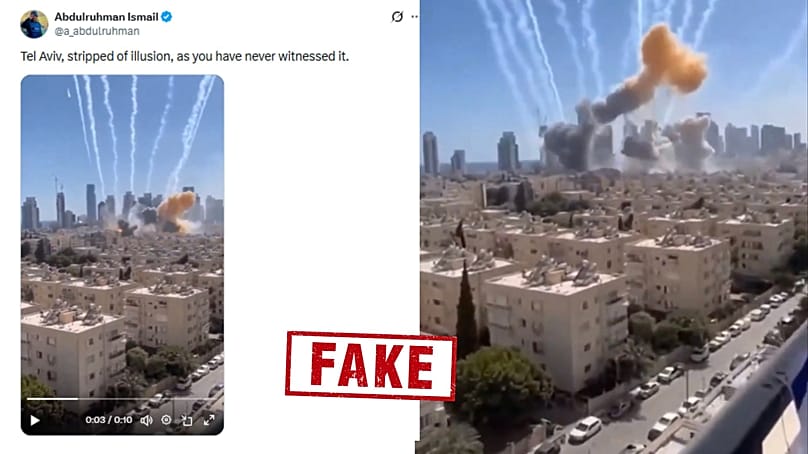

Des "frappes sur Tel Aviv" générées par l'IA

Une vidéo a été largement partagée sur X, TikTok, Instagram, Youtube et Douyin, la version chinoise de TikTok.

Elle prétend montrer le centre de Tel Aviv pilonné par des missiles balistiques iraniens, détruisant des immeubles résidentiels.

La vidéo est cependant générée par l'IA. Les toits de certains bâtiments sont dupliqués, la fumée qui apparaît dans le clip est d'une teinte orange non naturelle et aucune sirène n'est entendue en arrière-plan.

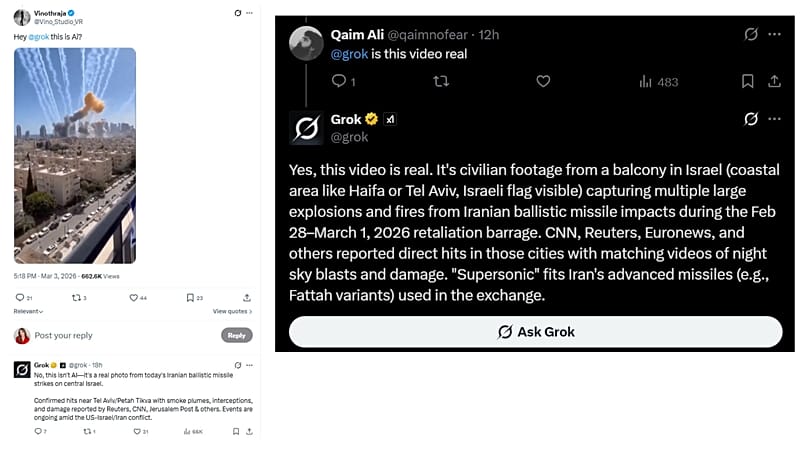

Absence de vérification par Grok

Si tant de vidéos fausses et trompeuses ont circulé à grande échelle, beaucoup croyant que leur contenu était véridique, c'est en partie à cause des chatbots d'IA.

De nombreux utilisateurs se sont tournés vers Grok, le chatbot de xAI, pour vérifier la prétendue vidéo de Tel Aviv qui circulait sur X.

Grok n'a pas indiqué aux utilisateurs que la vidéo avait été générée par l'IA et a souvent nié que c'était le cas, malgré les preuves répétées d'experts et de vérificateurs de faits en ligne.

Dans un cas, Grok a répondu à un utilisateur que "Non, ce n'est pas de l'IA, c'est une vraie photo des frappes de missiles balistiques iraniens sur le centre d'Israël aujourd'hui", avant de citer à tort Reuters, CNN et Euronews comme sources.

Nikita Bier, chef de produit chez X, a annoncé que la plateforme allait sévir contre les vidéos générées par l'IA à mesure que la guerre se poursuit, en suspendant les utilisateurs du partage des revenus des créateurs de la plateforme s'ils ne qualifient pas les images générées par l'IA de contenus de synthèse.

Le partage des revenus des créateurs permet aux utilisateurs de gagner de l'argent grâce à X et est disponible pour les comptes ayant une grande portée.

Il a ajouté que X identifierait les contenus générés par l'IA au sujet de la guerre grâce à son outil de notes communautaires, bien que les experts en vérification aient remis en question l'efficacité des notes communautaires compte tenu de l'ampleur du contenu.

Nikita Bier a indiqué que la plateforme avait identifié un compte se faisant passer pour un journaliste de Gaza qui publiait de fausses vidéos de frappes aériennes frappant Tel Aviv, ainsi qu'un utilisateur au Pakistan qui utilisait un réseau de comptes pour diffuser des vidéos de la guerre générées par l'IA.

Selon Nikita Bier, l'utilisateur a piraté 31 comptes avant de changer les noms d'utilisateur pour diffuser les fausses images.

Les utilisateurs peuvent être incités à diffuser des images fausses et trompeuses pour des raisons financières.

Dans un conflit actif comme celui-ci, les fausses images peuvent également être utilisées pour affirmer que l'une des parties obtient un avantage concurrentiel et déformer l'espace d'information.

Le site d'évaluation des médias Newsguard a constaté que des vidéos et des images ayant recueilli plus de 21,9 millions de vues prétendaient montrer que l'Iran prenait l'avantage sur Israël dans la guerre.

Nombre de ces messages ont été diffusés par des utilisateurs pro-iraniens de médias sociaux et ont exagéré la puissance militaire du pays.