Le premier algorithme de l'histoire a été écrit par Ada Lovelace au XIXè siècle. Aujourd'hui, écrits principalement par des hommes, ils renforcent les biais sexistes de notre société alors qu'ils interférent de plus en plus avec nos vies.

Le premier algorithme de l'histoire a été codé au XIXème siècle par Ada Lovelace, une femme. Deux siècles plus tard, les algorithmes "ont la capacité de nous faire reculer de plusieurs décennies" en matière d'égalité des sexes, selon Susan Leavy, chercheuse à l'University College de Dublin.

PUBLICITÉ

PUBLICITÉ

PUBLICITÉ

PUBLICITÉ

Elle travaille au sein d'un groupe de travail visant à empêcher les algorithmes d'intelligence artificielle d'apprendre des préjugés sexistes. Elle explique : "l_es algorithmes peuvent exacerber la masculinité toxique et les comportements que nous combattons depuis des décennies dans la société_".

Et ce n'est pas la faute des algorithmes eux-mêmes, mais de l'histoire humaine.

L'intelligence artificielle (IA) apprend à partir des données qui lui sont fournies. Or la plupart de ces données sont en réalité biaisées, explique Mme Leavy, "_m__ême celles qui se contentent de décrire le monde, en raison de la discrimination historique à l'égard des femmes._"

Ces machines tirent leur enseignement de données issues des dix ou vingt dernières années, reproduisant les préjugés qui existaient alors ; elles n’intègrent pas les avancées sociales conquises récemment. Elles n'ont donc pas entendu parler du mouvement féministe mondial #MeToo ni de l'hymne chilien "Un violeur sur ton chemin", par exemple.

"_Nous répétons les erreurs du pass_é", conclut la chercheuse.

Ce biais dans la programmation a un impact sur la vie quotidienne des femmes, de la recherche d'emploi aux contrôles de sécurité dans les aéroports.

Les pionnières de la programmation

Ada Lovelace (1815-1852) est devenue la première programmeuse de l'histoire, un siècle avant l'invention des ordinateurs. Au milieu du XIXe siècle, cette mathématicienne britannique a écrit une série d'instructions à suivre pour la machine informatique conçue par son collègue, le scientifique Charles Babbage, ce qui est considéré comme le tout premier algorithme.

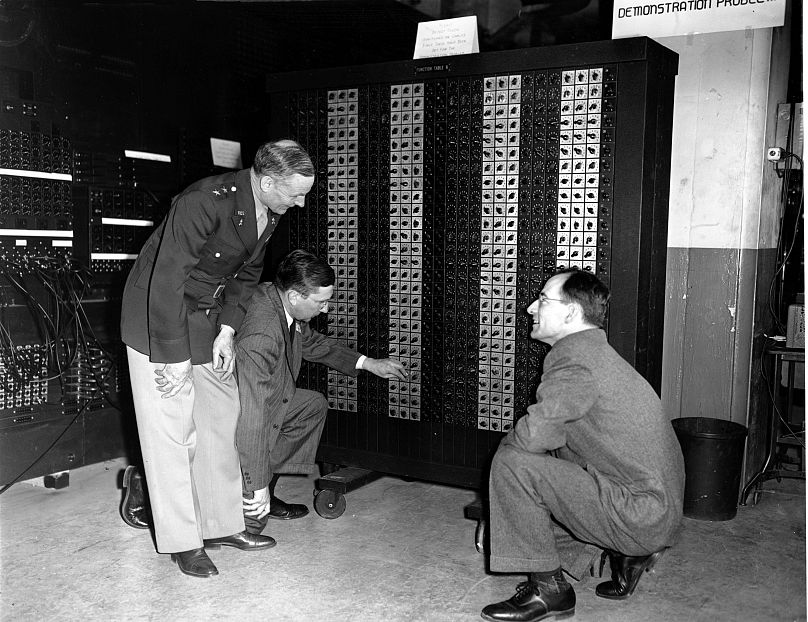

En fait, les pionniers de l'univers de la programmation étaient des pionnières, es femmes étant alors considérées comme plus aptes que les hommes aux tâches demandant de la précision. C'est le cas, par exemple, du programme de l'ENIAC (Electronic Numerical Integrator and Computer), projet secret de l'armée américaine de la Seconde Guerre mondiale, pour lequel six femmes ont programmé le premier ordinateur électronique. Et pourtant leurs noms ont été omis lors de sa présentation au public en 1946.

Quand seuls les hommes codent

Les femmes sont désormais minoritaires dans le domaine des sciences et des technologies et le secteur de la programmation est devenu de plus en plus masculin à partir des années 1980. Aujourd'hui, en Europe, 59% des scientifiques et ingénieurs sont des hommes selon les dernières données d'Eurostat.

Cette inégalité se retrouve de manière inconsciente dans l'écriture des algorithmes.

"Il y a un gros problème de disparité entre les sexes, en particulier dans le processus d'apprentissage des machines", explique Susan Leavy. "Cela signifie que nous manquons de perspective critique."

Pour un homme, il sera plus difficile de repérer les préjugés contre les femmes dans les données au moment de la programmation. "Je ne pense pas que la plupart des ingénieurs veuillent développer des algorithmes qui discriminent par sexe ou par race", dit-elle, ajoutant "ce sont juste de mauvais algorithmes."

Les intentions des programmeurs ne sont donc pas la question; ces derniers doivent surtout être formés pour être capables de détecter de tels biais.

Pour la chercheuse, l'idéal est de constituer des équipes comprenant des profils variés. C'est le cas de la sienne, qui travaille à éliminer les préjugés des algorithmes avant que les machines ne les apprennent. "Nous savons que les équipes qui ne sont pas diverses ne produisent pas de bons résultats".

La chercheuse estime donc qu'il est nécessaire d'avoir des femmes dans les équipes des entreprises de nouvelles technologies afin qu'elles puissent tester les programmes produits.

Comment les algorithmes discriminent-ils les femmes ?

"Aujourd'hui, l'intelligence artificielle, comme d'autres technologies basées sur les algorithmes, façonnent nos vies de manière significative et banale", rappelle Joy Lisi Rankin. Pour cette chercheuse sur la question du genre, de la race et du pouvoir dans l'intelligence artificielle à l'institut AI Now de New York, "nous nous en rendons rarement compte car les technologies nous sont invisibles et leur fonctionnement n'est pas du tout transparent." Or, "_c__es algorithmes déterminent, par exemple, qui a accès à des ressources ou des avantages importants_".

L'un des cas les plus connus de discrimination imputable à un système d'IA est l'échec du système d'embauche automatisé d'Amazon.

En 2018, la multinationale américaine a fini par abandonner son outil d'intelligence artificielle, avec lequel elle sélectionnait des candidats depuis quatre ans, car il s'est révélé sexiste.

Cet algorithme d'Amazon s'est formé sur la base des modèles de CV soumis à l'entreprise pendant une décennie, selon l'enquête de Reuters qui a révélé l'abandon du programme. Or, comme le secteur des nouvelles technologies est un milieu très masculin, la plupart des candidatures sur lesquelles il s'est construit étaient des CV d'hommes.

"Le domaine du recrutement est un domaine très problématique", explique Susan Leavy. "Même si vous dites aux algorithmes d'IA d'ignorer le sexe, ils trouvent d'autres moyens de le découvrir."

L'algorithme d'Amazon pénalisait ainsi les CV qui comportaient des mots liés au genre, même dans les loisirs des candidats, comme "capitaine de l'équipe féminine de rugby".

Ce type d'algorithmes ne possèdent pas qu'un biais genré ; ils sanctionnent toute forme de diversité, en privilégiant une succession de schémas qui finissent par favoriser la partie la plus privilégiée et la plus représentée de la société : les hommes blancs.

Les systèmes de reconnaissance faciale pose aussi problème, nous explique Susan Leavy. "Si vous êtes une femme à la peau sombre, il marchera encore moins bien."

La conséquence peut être minime, par exemple vous pourriez avoir plus de mal à déverrouiller votre téléphone via la reconnaissance faciale. Mais cela peut aussi vouloir dire avoir plus de difficultés à passer un contrôle de sécurité automatisé.

"A l'aéroport, si vous êtes un homme blanc, vous passerez rapidement. Si vous êtes une femme à la peau foncée, vous avez beaucoup plus de chances de faire la queue plus longtemps." explique-t-elle.

Un autre espace où les algorithmes sexistes ont un impact crucial sur la vie des femmes est celui des moteurs de recherche et des réseaux sociaux.

"Ils catégorisent et traitent les utilisateurs différemment en fonction d'un certain nombre de stéréotypes", détaille Mme Leavy. "Le 'plus dangereux' est qu'ils utilisent ces classifications pour envoyer des publicités personnalisées, notamment aux jeunes qui sont plus influençables".

La chercheuse Joy Lisi Rankin donne des exemples : "Facebook proposent des annonces pour des emplois mieux payés aux hommes blancs, alors que les femmes et les personnes de couleur se voient proposer des annonces pour des emplois moins bien payés. Google, quant à lui, renvoient des résultats sexistes et pornographiques aux requêtes 'filles noires' ou 'latinas'".

Et si les algorithmes nous aidaient plutôt à combattre le sexisme ?

Les nouvelles réglementations de l'Union européenne pour le développement de l'IA attestent d'"une prise de conscience croissante", selon Susan Leavy.

Elle précise que la Commission européenne d'Ursula von der Leyen s'est emparée de la question et en a fait une priorité. Toutefois, "cela peut prendre 10 ans" avant que les premiers effets ne se fassent sentir.

Pour changer les choses, elle estime qu'il faut impliquer des équipes multidisciplinaires afin de représenter les points de vue des hommes et des femmes.

Les algorithmes pourraient au contraire nous aider à lutter contre la discrimination, par exemple, contre le sexisme dans les processus de recrutement. Une machine pourrait être plus impartiale qu'un être humain lors de la sélection des candidats... si son apprentissage est bon.

"Je dois en voir plus pour y croire", précise Suan Leavy. Mais les algorithmes ont ce potentiel" même si "ce n'est pas la façon dont nous les utilisons pour le moment."